Anthropic Colossus: più compute per Claude

Anthropic ha firmato un accordo di compute con SpaceX per usare Colossus 1: oltre 300 MW e 220.000 GPU NVIDIA. Limiti più alti per Claude Code, niente throttling nelle ore di punta su Pro/Max e rate limit API più ampi per Opus. Cosa significa per le aziende che costruiscono con l'IA.

In sintesi

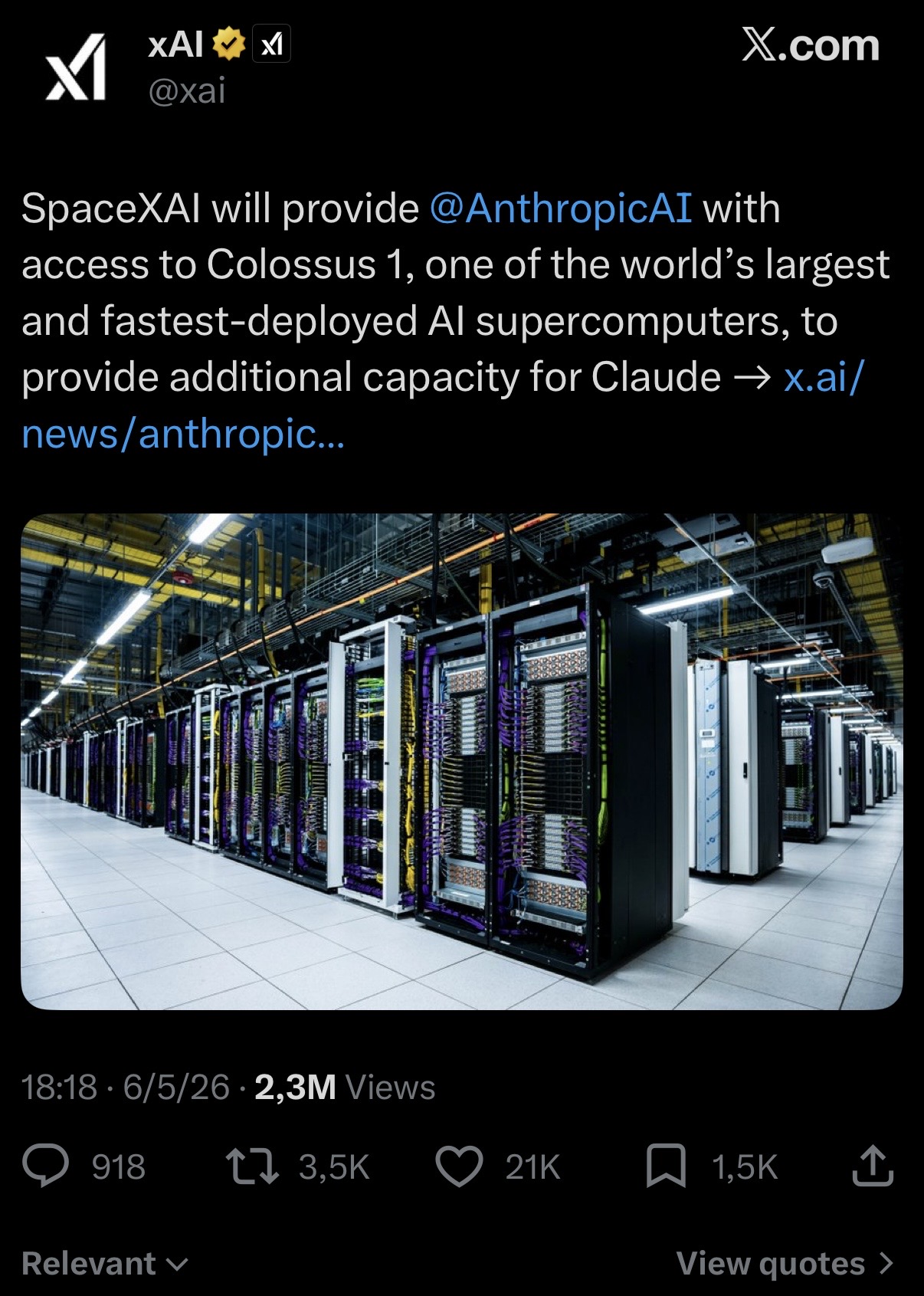

Anthropic ha firmato un accordo con SpaceX per utilizzare la capacità di calcolo di Colossus 1, il grande data center associato all'ecosistema di xAI. La parte interessante non è solo la collaborazione tra aziende rivali nell'IA, ma ciò che rivela: il collo di bottiglia dell'IA non è più solo avere modelli migliori, ma avere infrastruttura sufficiente per servirli senza attriti.

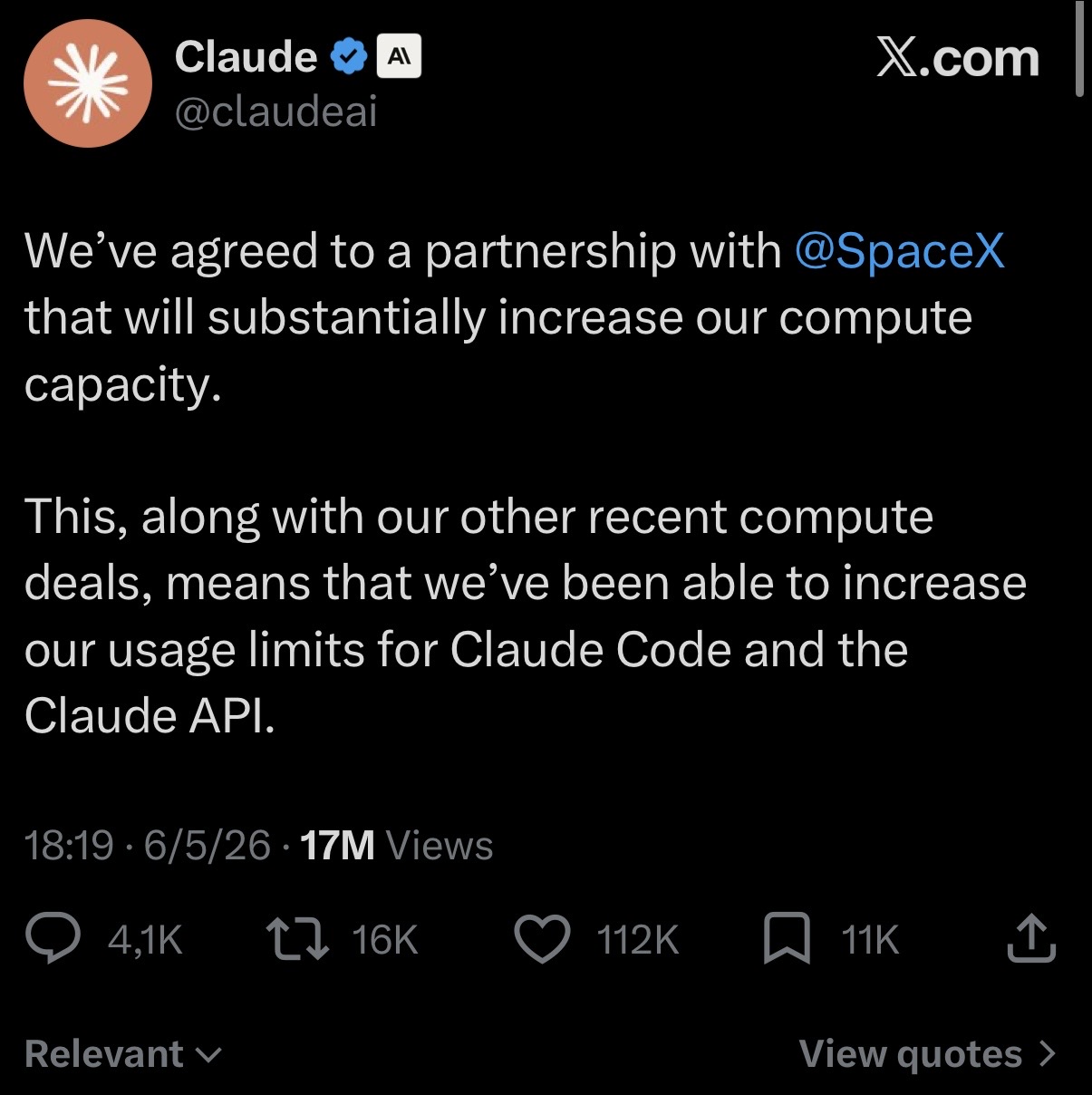

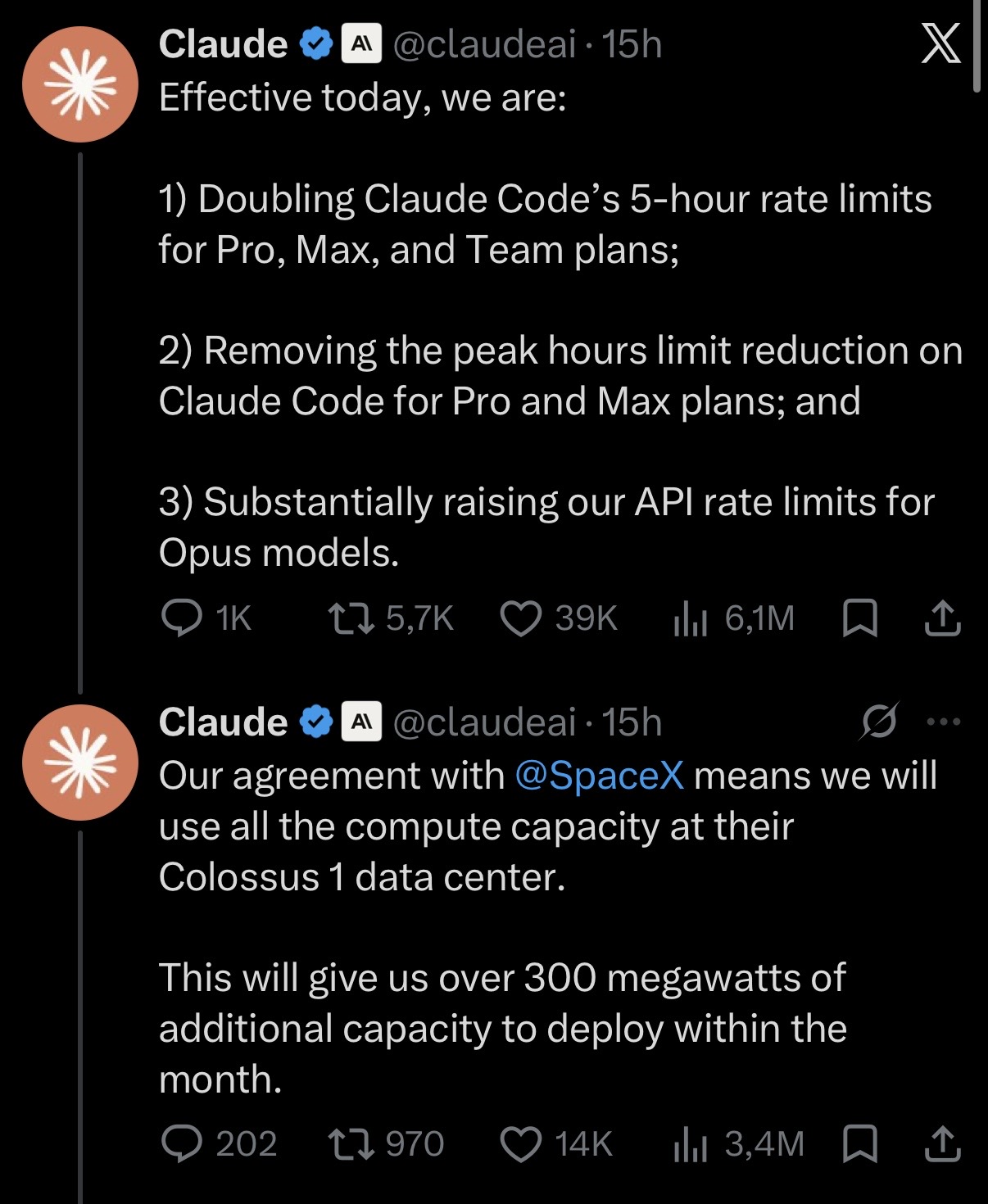

In pratica, Anthropic sta già traducendo tutto questo in tre cambiamenti concreti per gli utenti: più limiti per Claude Code, eliminazione delle restrizioni nelle ore di punta per i piani Pro e Max, e rate limit più alti per l'API di Claude Opus.

Cosa ha annunciato Anthropic

Anthropic ha comunicato un accordo con SpaceX per usare l'intera capacità di calcolo del data center Colossus 1. Secondo l'annuncio ufficiale, questo le darà accesso a oltre 300 MW di nuova capacità e più di 220.000 GPU NVIDIA, che verranno integrate nel corso di questo mese.

La lettura superficiale sarebbe dire che Anthropic si appoggia su un'infrastruttura legata all'ecosistema di Elon Musk. Ma non è la parte più interessante.

Il punto è che Anthropic ha bisogno di più compute perché Claude non compete più solo come modello: compete come prodotto utilizzato da sviluppatori, team tecnici, aziende e utenti intensivi che si aspettano disponibilità costante.

Cosa cambia subito per gli utenti di Claude

Anthropic ha annunciato tre cambiamenti effettivi dallo stesso giorno dell'annuncio:

- Raddoppia i limiti delle cinque ore di Claude Code per Pro, Max, Team ed Enterprise per posto.

- Elimina la riduzione dei limiti nelle ore di punta per Claude Code sugli account Pro e Max.

- Aumenta sensibilmente i rate limit dell'API per i modelli Claude Opus.

Questo non significa che Claude abbia automaticamente un nuovo modello, né che cambi l'interfaccia, né che esista un'integrazione diretta con Grok. Il cambiamento è più operativo: più capacità disponibile per sostenere l'uso reale.

Per gli utenti Pro e Max, la promessa è chiara: meno attriti, meno blocchi per limiti e più margine per usare Claude come strumento di lavoro quotidiano.

Perché questo conta per aziende e PMI

Per un'azienda, il valore di uno strumento di IA non dipende solo da quanto sembra intelligente in una demo. Dipende dal fatto che possa essere usato in modo affidabile dentro processi reali.

Quando un team usa Claude Code per rivedere repository, generare test, documentare moduli, analizzare errori o accelerare attività di sviluppo, i limiti d'uso diventano un vincolo di produttività. Se lo strumento si interrompe a metà del flusso, smette di essere un vantaggio operativo e diventa una dipendenza scomoda.

Ecco perché questa notizia conta: Anthropic sta rafforzando lo strato che di solito l'utente non vede, ma che determina l'esperienza finale.

Più compute significa più capacità di inferenza, più margine per gli utenti intensivi e meno pressione sui limiti di prodotto.

La nuova competizione dell'IA: infrastruttura, energia e disponibilità

Negli ultimi anni il dibattito pubblico si è concentrato su quale modello sia più intelligente: GPT, Claude, Gemini, Grok o Llama. Ma la fase successiva della competizione sembra meno appariscente e più strategica.

La domanda non è più solo chi ha il modello migliore.

La domanda è chi può eseguirlo su scala, con energia, hardware, data center e accordi infrastrutturali sufficienti.

Qui entra in gioco Colossus 1. Il suo valore non sta nell'essere un brand attraente, ma nel rappresentare una tendenza: i grandi laboratori di IA hanno bisogno di quantità enormi di compute per addestrare, servire, mettere a punto e scalare i loro prodotti.

Cosa non è stato annunciato

Conviene separare i fatti dall'interpretazione.

Anthropic non ha annunciato un calo dei prezzi.

Non ha nemmeno annunciato un nuovo modello Claude direttamente legato a questo accordo.

E non c'è un'integrazione di prodotto tra Claude e Grok per l'utente finale.

Ciò che è confermato è più concreto e, per gli utenti intensivi, probabilmente più importante: più capacità di calcolo per ridurre le restrizioni e migliorare la disponibilità.

Lettura E2D

In E2D la lettura è chiara: l'IA aziendale non si vince solo con i prompt o con i titoli sui nuovi modelli. Si vince quando la tecnologia può essere integrata in processi reali senza rompere il flusso di lavoro.

Per una PMI, tutto questo si traduce in un'idea semplice:

Se uno strumento di IA deve diventare parte di vendite, supporto, sviluppo, operations o analisi interna, deve essere affidabile, disponibile e scalabile.

L'annuncio di Anthropic e Colossus è rilevante perché punta esattamente a quello strato: l'infrastruttura che permette all'IA di smettere di essere uno strumento occasionale e diventare una parte stabile del lavoro quotidiano.

Cosa dovrebbero osservare ora le aziende

Primo, se usano Claude Code o l'API di Anthropic, dovrebbero rivedere i loro limiti attuali e valutare se i nuovi margini permettono casi d'uso più ambiziosi.

Secondo, se stanno confrontando fornitori di IA, non dovrebbero valutare solo la qualità delle risposte. Dovrebbero anche guardare a disponibilità, limiti, pricing, supporto enterprise, regioni di inferenza e capacità di integrazione.

Terzo, se stanno progettando automazioni con IA, dovrebbero assumere che l'infrastruttura del fornitore sia una variabile critica. Un flusso automatizzato non ha bisogno solo di buone risposte; ha bisogno di consistenza.

Conclusione

L'accordo tra Anthropic e SpaceX intorno a Colossus 1 non è solo una notizia di infrastruttura. È un segnale di dove sta andando l'IA.

I modelli continueranno a contare, ma il vantaggio competitivo inizia a dipendere anche dalla capacità di servirli su scala.

Più compute non è un dettaglio tecnico. È ciò che permette a strumenti come Claude di passare dall'essere potenti in test isolati all'essere utili in operazioni reali.

E per le aziende, è la differenza tra provare l'IA e costruire con l'IA.

Domande frequenti

Claude cambierà modello a causa di questo accordo?

Non è stato annunciato un nuovo modello Claude direttamente legato all'accordo. L'annuncio si concentra sulla capacità di calcolo e sui limiti d'uso.

Quali utenti noteranno per primi il cambiamento?

Principalmente utenti intensivi di Claude Code, piani Pro e Max, team Team ed Enterprise per posto, e organizzazioni che usano l'API di Claude Opus.

Questo significa che Claude e Grok si integrano?

No. Non c'è alcuna integrazione annunciata tra Claude e Grok. L'accordo riguarda infrastruttura e capacità di calcolo.

Perché il compute è così importante nell'IA?

Perché i modelli di IA hanno bisogno di molta capacità per addestrarsi, mettersi a punto e rispondere a milioni di utenti. Senza infrastruttura sufficiente, compaiono limiti, saturazione e restrizioni d'uso.

Fonti

- Anthropic: Higher limits announcement

- xAI: Anthropic compute partnership

¿Hablamos de tu proyecto?

Ti interessa automatizzare la tua azienda?

Prenota una demo gratuita e scopri come possiamo aiutarti